Nội dung yêu cầu trả phí!

Bạn cần có thẻ thành viên trọn đời để có thể bắt đầu xem tài liệu / ebook / video này!

Mua ngay Nếu bạn mua trước đó nhưng không thể truy cập? Hãy nhắn cho tôi!Giới thiệu

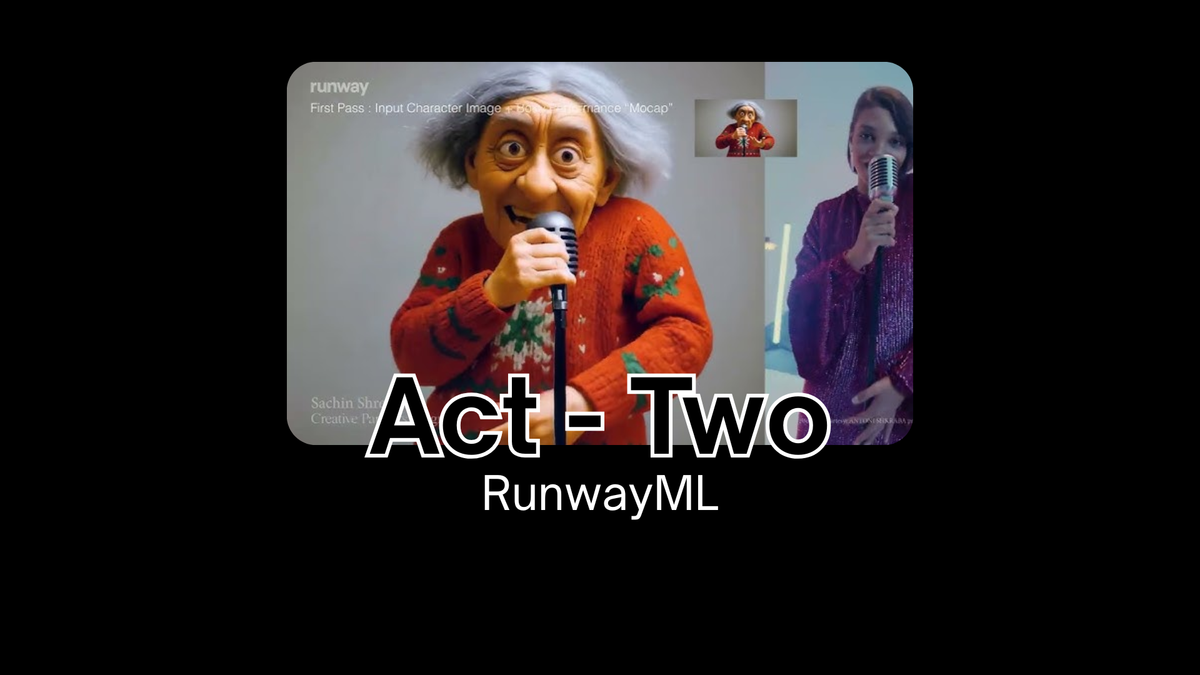

Act‑Two là mô hình sao chép biểu cảm và hành động mới nhất của RunwayML, nó cho phép bạn điều khiển nhân vật trong video kết quả bằng cách sử dụng video điều khiển đầu vào (driving performance).

Với RunwayML Act-Two, bạn chỉ cần cung cấp:

- Video điều khiển: Một người đang diễn lại cảnh bạn muốn mô phỏng, và

- Tham chiếu nhân vật: Hình ảnh hoặc video của nhân vật mục tiêu.

Act‑Two sẽ chuyển động tác, lời nói và biểu cảm từ video trình diễn sang nhân vật, tạo ra chuyển động, giọng nói và biểu cảm chân thực.

Khi bạn dùng hình ảnh nhân vật, Act‑Two cho phép kiểm soát cử động tay và cơ thể thông qua thiết lập Gesture control (điều khiển cử chỉ). Đồng thời, Act‑Two tự động thêm chuyển động môi trường vào hình ảnh tĩnh để tạo cảnh quay tự nhiên chỉ trong một lần gen video.

Bài viết này sẽ cho bạn cái nhìn tổng quan về quy trình tạo Act‑Two, bao gồm các best practices, lưu ý về đầu vào và hướng dẫn chi tiết giúp đạt kết quả tối ưu.

Thông báo quan trọng:

Act‑Two đang được triển khai theo từng giai đoạn và hiện chỉ khả dụng cho tài khoản Enterprise và CPP.

Điểm nhấn của bài

- Hoạt động tốt với nhiều góc máy, nhân vật phi nhân loại và đa phong cách.

- Điều khiển cử chỉ (Gesture control) khả dụng khi dùng hình ảnh nhân vật.

Act‑Two tự động thêm chuyển động môi trường cho đầu vào là hình ảnh nhân vật.

Thông số kỹ thuật Act‑Two

| Hạng mục | Chi tiết |

|---|---|

| Chi phí | 5 credit/giây, tối thiểu 3 giây |

| Thời lượng hỗ trợ | Tối đa 30 giây |

| Tạo vô hạn trong Explore Mode | Có |

| Nền tảng | Web |

| Đầu vào chính | Video trình diễnNhân vật: Hình ảnh hoặc Video |

| Độ phân giải xuất | 16:9 — 1280 × 720 px 9:16 — 720 × 1280 px 1:1 — 960 × 960 px 4:3 — 1104 × 832 px 3:4 — 832 × 1104 px 21:9 — 1584 × 672 px |

| Tốc độ khung hình | 24 fps |

| Gesture control | Hỗ trợ khi dùng hình ảnh nhân vật |

Bước 1 — Chọn các đầu vào (Selecting the inputs)

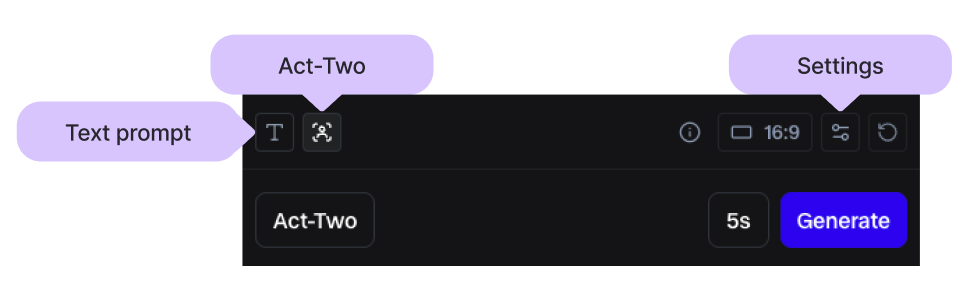

1.1. Truy cập Act‑Two trong Runway

- Mở một phiên làm việc (session) trong bảng điều khiển (dashboard) của bạn.

- Bảo đảm đã chọn mô hình Gen‑4 Video.

- Nhấp vào biểu tượng Act‑Two ở góc dưới bên trái màn hình.

Bạn có thể chuyển về chế độ Gen‑4 Video bất cứ lúc nào bằng cách chọn lại biểu tượng Text prompt.

1.2. Cung cấp 2 đầu vào bắt buộc

| Loại đầu vào | Mô tả |

|---|---|

| Driving performance | Video ghi lại một người đang diễn cảnh bạn muốn mô phỏng. Video này chứa chuyển động, biểu cảm khuôn mặt, cử chỉ và âm thanh sẽ được chuyển sang nhân vật. Bạn có thể: • Ghi hình trực tiếp trong web‑app, hoặc • Kéo‑thả (drag & drop) file video từ máy tính lên khung nhập. |

| Character input | Hình ảnh hoặc video của nhân vật mà bạn muốn “thổi hồn”. |

1.3. Chọn hình ảnh hay video nhân vật?

| Hình ảnh nhân vật | Video nhân vật | |

|---|---|---|

| Chuyển động môi trường | Tự động thêm rung máy nhẹ, chuyển động camera, gió, v.v. | Giữ nguyên chuyển động camera và môi trường gốc của video. |

| Gesture control | Có – Chuyển động tay/cơ thể được lấy từ video trình diễn. | Không – Chỉ chuyển nét mặt (facial motion). |

| Khi nào nên dùng? | • Khi chưa có video nhân vật dài tương đương video trình diễn. • Khi muốn Act‑Two tự dựng cảnh động. | • Khi bạn cần giữ chính xác góc máy, hậu cảnh, nhịp máy quay gốc trong nhân vật. |

Kết quả khi dùng hình ảnh nhân vật bổ sung một độ rung máy nhẹ kiểu cầm tay và cho phép điều khiển cử chỉ, trong khi video nhân vật chỉ thêm chuyển động khuôn mặt nhưng giữ nguyên chuyển động camera và bối cảnh gốc.

Nếu bạn vẫn phân vân nên dùng hình ảnh hay video nhân vật, hãy xem xét các yếu tố sau:

1.3.1. Độ dài của video điều khiển và video nhân vật

- Khi video trình diễn dài hơn video nhân vật, video nhân vật sẽ lặp lại theo hiệu ứng “boomerang” đảo chiều để khớp thời lượng.

- Nếu bạn muốn kết quả tự nhiên mà không có video nhân vật có độ dài tương ứng, hãy cân nhắc sử dụng hình ảnh nhân vật.

1.3.2. Mức độ quan trọng của việc kiểm soát chuyển động camera & môi trường

- Video nhân vật sẽ giữ nguyên chuyển động camera, nhân vật và môi trường gốc trong bản xuất.

- Hình ảnh nhân vật khiến Act‑Two tự động thêm chuyển động camera và môi trường.

Nếu cảnh quay của bạn đòi hỏi chuyển động camera hoặc môi trường cụ thể, sử dụng video nhân vật sẽ lý tưởng hơn.

Ngoài các yếu tố trên, luôn đảm bảo đầu vào tuân thủ thực tiễn tốt nhất để đạt chất lượng cao nhất.

1.4. Làm gì thì tốt nhất? - Best practices

1.4.1. Video điều khiển (Performance video)

- Chỉ có một chủ thể trong khung hình

- Khuôn mặt phải luôn nhìn thấy suốt video

- Khung hình tối đa từ thắt lưng trở lên

- Ánh sáng tốt, đường nét khuôn mặt rõ

- Không cắt cảnh làm gián đoạn

- Tuân thủ chuẩn Trust & Safety của Runway

- [Cử chỉ] Tay nhân vật phải xuất hiện trong khung ngay đầu video

- [Cử chỉ] Bắt đầu ở tư thế tương tự với tư thế của nhân vật để đạt kết quả tốt nhất

- [Cử chỉ] Di chuyển tự nhiên, tránh động tác quá mạnh hoặc đột ngột

1.4.2. Hình ảnh nhân vật (Character image)

- Chỉ có một chủ thể

- Khung hình tối đa từ thắt lưng trở lên

- Khuôn mặt rõ, có mắt và miệng phân biệt

- Tuân thủ tiêu chuẩn Trust & Safety

- [Cử chỉ] Tay nhân vật nên thấy được trong ảnh để phù hợp video điều khiển

1.4.3. Video nhân vật (Character video)

- Chỉ có một nhân vật trong video

- Khung hình tối đa từ thắt lưng trở lên

- Khuôn mặt rõ nét

- Không cắt cảnh

- Thời lượng nên gần bằng video trình diễn để kết quả tự nhiên nhất

Sau khi đã chuẩn bị các đầu vào theo thực tiễn tốt nhất, bạn có thể tiếp tục sang bước xem lại và điều chỉnh thiết lập.

Bước 2 — Cấu hình các thiết lập

Trước khi bắt đầu quá trình sinh video, bạn có 2 thiết lập cần xem xét:

2.1. Cử chỉ (Gestures)

- Thiết lập Gestures quyết định xem tư thế, cử chỉ và chuyển động cơ thể từ video trình diễn có được chuyển sang hình ảnh nhân vật hay không.

- Khi tắt tùy chọn này, Act‑Two chỉ thêm chuyển động khuôn mặt và môi trường (camera rung nhẹ, chuyển cảnh) cho nhân vật.

- Thiết lập không khả dụng nếu bạn dùng video nhân vật, vì chuyển động cơ thể đã cố định trong chính video đó rồi.

Ví dụ minh họa: Video dưới đây cho thấy sự khác biệt khi bật và tắt tùy chọn Gesture với cùng một bộ đầu vào (video trình diễn + hình ảnh nhân vật).

Như ví dụ trên minh họa, khi bật tùy chọn Gestures - On, Act‑Two sẽ bám sát chuyển động trong video điều khiển và có thể thay đổi tư thế của nhân vật. Nếu bạn muốn giữ tư thế hoặc hướng nhìn tương tự, hãy cố gắng đưa nhân vật trong video điều khiển vào tư thế gần giống với tư thế của hình ảnh nhân vật ngay từ đầu.

2.2. Biểu cảm khuôn mặt (Facial expressiveness)

Thiết lập Facial expressiveness điều chỉnh mức độ chuyển động khuôn mặt được truyền từ video trình diễn sang đầu vào nhân vật. Giá trị mặc định là 3, nhưng bạn có thể giảm hoặc tăng tùy tình huống:

| Giá trị | Hiệu ứng chính | Lưu ý |

|---|---|---|

| Thấp hơn (< 3) | Biểu cảm ít hơn | Giúp nhân vật giữ nét ổn định tốt hơn trong một số trường hợp |

| Cao hơn (> 3) | Biểu cảm mạnh hơn | Có thể xuất hiện hiện tượng méo hình (artifacts) trong một số cảnh |

Khuyến nghị: Hãy thử trước với giá trị mặc định 3. Sau khi xem trước kết quả, điều chỉnh lên hoặc xuống để đạt được mức biểu cảm mong muốn mà vẫn đảm bảo chất lượng hình ảnh.

Bước 3 — Tạo video Act‑Two (Generating)

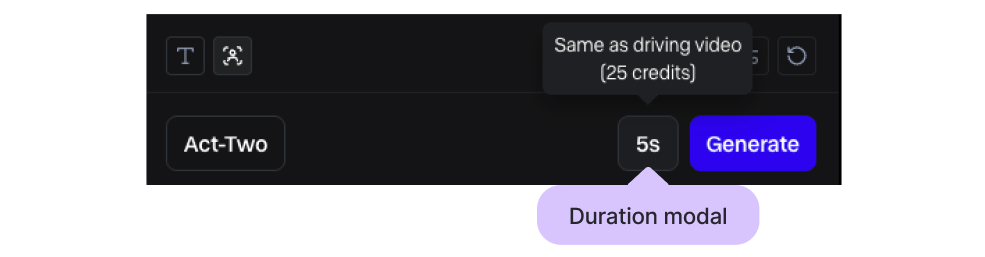

- Kiểm tra lại các thiết lập:

Luôn kiểm tra các đầu vào và tùy chọn trước khi nhấn Generate. - Xem trước chi phí:

Di chuột lên hộp thời lượng (duration modal) để xem số credit dự kiến trước khi tạo, chắc chắn rằng bạn có đủ credit để bắt đầu. - Nhấn Generate:

Sau khi xác nhận mọi thứ, bấm Generate. Video sẽ bắt đầu xử lý ngay trong phiên làm việc hiện tại; từng bản dựng hoàn tất sẽ xuất hiện trong danh sách phiên làm việc để bạn xem và tải xuống.

Cách tính giá cho Act‑Two

Act‑Two tính phí 5 credit mỗi giây với mức tối thiểu 3 giây.

Điều này có nghĩa là các video trình diễn dưới 3 giây sẽ bị tính phí 15 credit.